Tego typu obrazki kojarzymy głównie z filmami science-fiction z lat 70. i 80., które później niejednokrotnie stawały się przykładami tego, jak błędnie wyobrażamy sobie przyszłość. Jak na ironię okazuje się jednak, że futuryści wcale nie mijali się daleko z prawdą w swoich przewidywaniach. Po prostu trzeba było czasu, by posiadana przez nas technologia pozwoliła na tak śmiałe wizje. I wygląda na to, że już taką dysponujemy.

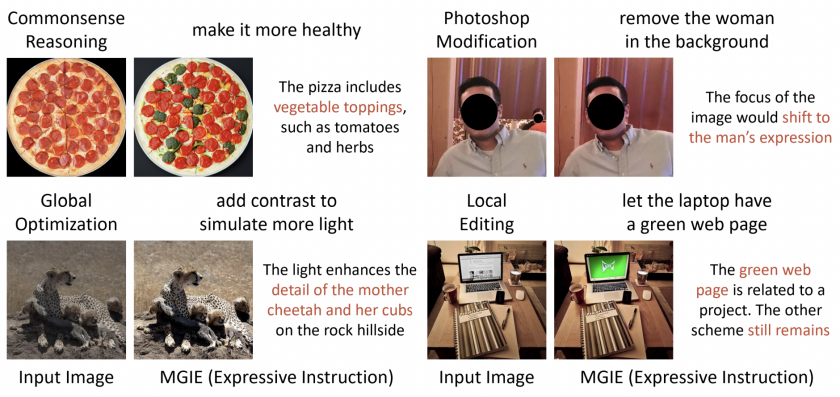

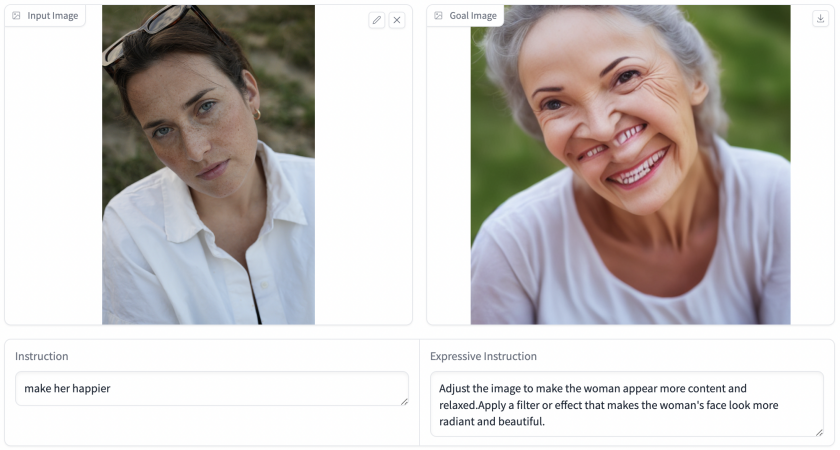

Apple wspólnie z Uniwersytetem Kalifornijskim zaprezentowało narzędzie o nazwie MGIE (MLLM-Guided Image Editing), które ma szansę naruszyć dogmaty panujące w branży. W dużym skrócie, to bazujący na sieciach neuronowych model językowy, którego zadaniem jest edycja obrazu przy pomocy określonych komend. W odłożeniu jednak od promptów, których używamy w generatorach AI czy też funkcji Generative Fill w Photoshopie, MGIE skupia się przede wszystkim na jak najlepszym zrozumieniu intencji użytkownika i nie ogranicza się wyłącznie do ściśle określonych celów.

"Rozmowa" z programem zamiast manualnej edycji

W założeniu, bazujący na rozwiązaniu Apple program byłby w stanie przeprowadzić cały proces obróbki zdjęcia wyłącznie na podstawie komunikacji z użytkownikiem, rozumiejąc zarówno bardzo specyficzne komendy (np. „Zwiększ saturację nieba o 20%”), jak i abstrakcyjne polecenia, które choć funkcjonują w naszym języku, to są trudne do zrozumienia dla komputera. Jednym z przykładów projektu opublikowanego w serwisie GitHub jest obrazek pizzy, na którym za sprawą polecenia „make it more healthy” pojawiają się warzywa i przyprawy.

Oprócz tego, MGIE ma być w stanie dokonywać edycji zarówno na poziomie globalnym, jak i na płaszczyźnie lokalnych edycji, dotyczących tylko określonego obszaru czy nawet pojedynczych pikseli. Główne obszary możliwości systemu prezentują się następująco:

- Ekspresyjna edycja oparta na instrukcjach: MGIE może tworzyć zwięzłe i jasne instrukcje, które skutecznie kierują procesem edycji. Nie tylko poprawia to jakość edycji, ale także zwiększa ogólne wrażenia użytkownika.

- Modyfikacja w stylu Photoshopa: MGIE może wykonywać typowe edycje w stylu Photoshopa, takie jak przycinanie, zmiana rozmiaru, obracanie, odbijanie czy dodawanie filtrów. Model może również stosować bardziej zaawansowane edycje, takie jak zmiana tła, dodawanie lub usuwanie obiektów oraz mieszanie obrazów.

- Globalna optymalizacja zdjęć: MGIE może zoptymalizować ogólną jakość zdjęcia, taką jak jasność, kontrast, ostrość i balans kolorów. Model może również stosować efekty artystyczne, takie jak szkicowanie, malowanie i rysowanie kreskówek.

- Edycja lokalna: MGIE może edytować określone regiony lub obiekty na zdjęciu, takie jak twarze, oczy, włosy, ubrania i akcesoria. Model może również modyfikować atrybuty tych regionów lub obiektów, takie jak kształt, rozmiar, kolor, tekstura i styl.

Podsumowując, model MGIE zaimplementowany w dobrze opracowanej aplikacji wielu osobom byłby w stanie zastąpić Photoshopa czy Lightrooma. W praktyce oznaczałoby to zapewne porzucenie myszki i konieczność nauczenia się zupełnie nowego sposobu obcowania z komputerem.

MGIE pokazuje jak może wyglądać edycja przyszłości. Czy jesteśmy na nią gotowi?

Biorąc pod uwagę to, jak mocno zakorzenieni jesteśmy w naszym obecnym workflow, może wydawać się to karkołomnym wymaganiem. Co więcej, nietrudno wyobrazić mi sobie sytuację gdzie myszka czy skróty klawiaturowe okażą się szybsze niż wydawanie komend (nawet głosowych). Jeśli jednak spojrzymy nieco w przód, tego typu rozwiązania mogą okazać się dużo bardziej adekwatne niż może nam się wydawać.

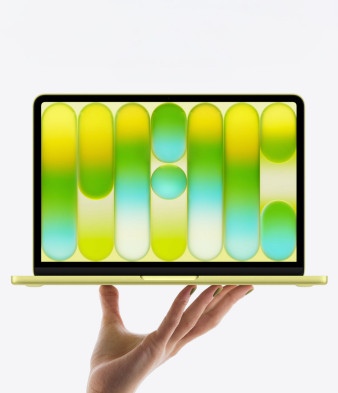

Raptem kilka dni temu swoją premierę miały gogle Apple Vision Pro. I choć recenzenci wytykają konstrukcji poszczególne niedociągnięcia, to zgodni są co do jednego - Apple pokazało jak może wyglądać przyszłość komputerów. A biorąc pod uwagę popularność firmy i zainteresowanie wśród użytkowników, przyszłość ta ma dużo większą szansę rzeczywiście się ziścić niż było to w przypadku Google Glass.

Za kilka lat godle czy też okulary XR mogą stać się naszym podstawowym cyfrowym interfejsem, gdzie zamiast myszki i klawiatury wykorzystywać będziemy gesty i komendy głosów. W takim scenariuszu MGIE mogłoby okazać się nie tylko wygodne, ale i dużo bardziej efektywne od tradycyjnych rozwiązań, które wykorzystujemy w edycji.

W końcu, nawet jeśli systemu takiego jak MGIE mielibyśmy używać bardziej tradycyjnie, mógłby stać się on doskonałym asystentem, który znacznie przyspieszyłby proces edycji, gdzie proste szybkie manipulacje wykonywalibyśmy sami, a bardziej skomplikowane procesy, jak maskowanie czy dokonywanie żmudnych korekt zostawialibyśmy komputerowi.

Na gotowy produkt jeszcze poczekamy, ale możliwości MGIE możemy już testować

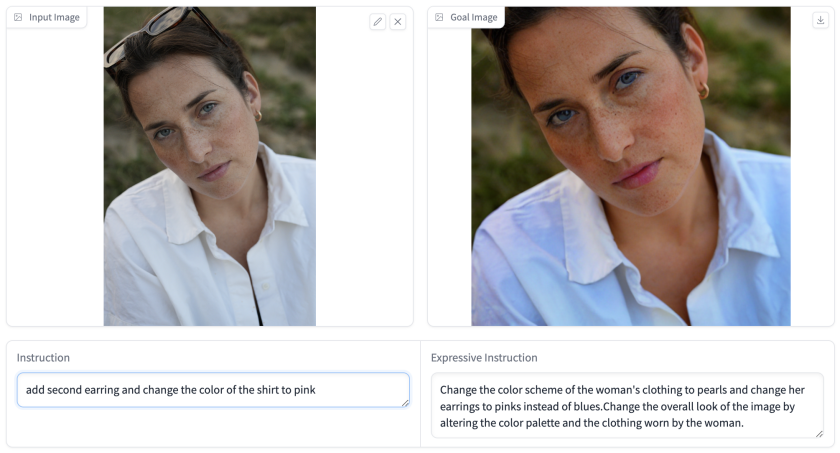

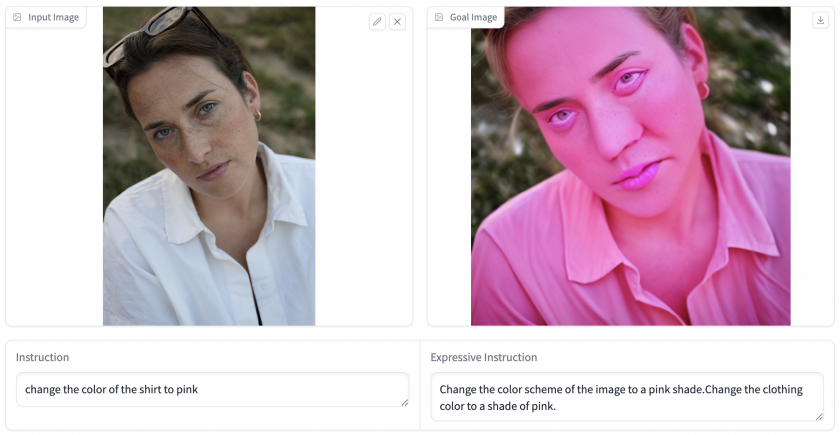

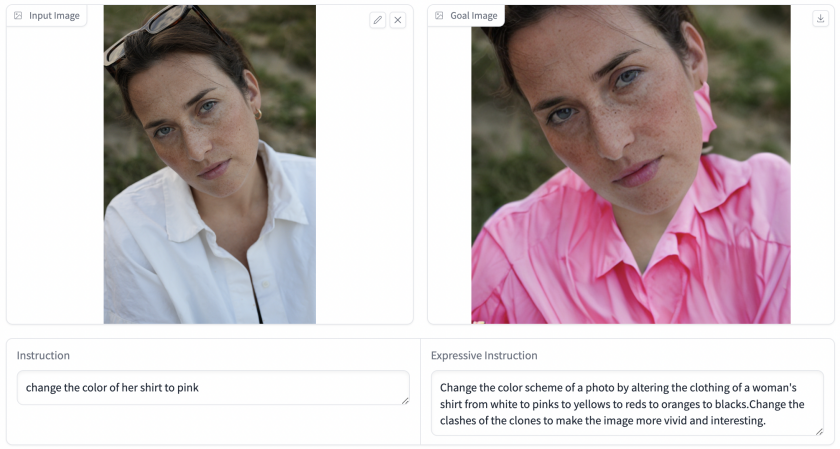

Póki co, wszystko to jednak pozostaje jeszcze w sferze domysłów. Jak na razie Apple i University of California udostępnili swój projekt w formie open-source w serwisie GitHub w celu zaprezentowanie technologii i zebrania feedbacku. Jak sprawdziliśmy w udostępnionym online demo, rozwiązanie jest także jeszcze mocno niedoskonałe - błędnie analizuje polecenia i ma problemy z utrzymaniem wyglądu zdjęcia źródłowego. Poniżej kilka przykładów mało udanej komunikacji z modelem.

To jednak dopiero początki, a biorąc jednak pod uwagę perspektywy i błyskawiczny rozwój systemów AI, jesteśmy przekonani, że prędzej czy później MGIE zostanie znacznie dopracowane i zaprezentowane w formie osobnej aplikacji Apple lub też licencjonowane któremuś z producentów oprogramowania graficznego.

Szczegóły dotyczące MGIE i znajdziecie na stronie projektu w serwisie GitHub. Systemem możemy pobawić się także online, pod adresem huggingface.co.